Telegram敏感内容过滤:平衡自由与安全的微妙艺术

在数字通信时代,Telegram以其强大的加密功能和注重隐私的理念,吸引了全球数亿用户。然而,与任何开放平台一样,它也面临着如何管理用户生成内容、特别是敏感或有害信息的挑战。Telegram的敏感内容过滤机制,并非一个简单的“开关”,而是一套植根于其核心哲学与社区准则的复杂体系,体现了在言论自由与社区安全之间寻找平衡的持续努力。

默认设置与用户自主权

Telegram的核心理念之一是赋予用户控制权。与许多平台主动扫描和过滤所有内容不同,Telegram采取了不同的路径。在默认情况下,其公共频道和群组中的内容不会进行主动的、全面的敏感内容过滤。然而,这并不意味着它是一个“无法之地”。Telegram通过其《服务条款》和《社区指南》明确禁止非法内容,包括但不限于恐怖主义宣传、儿童虐待材料、极端暴力以及煽动仇恨的行为。对于这类最严重的违规内容,Telegram设有专门的举报渠道,并在核实后采取封禁等处置措施。

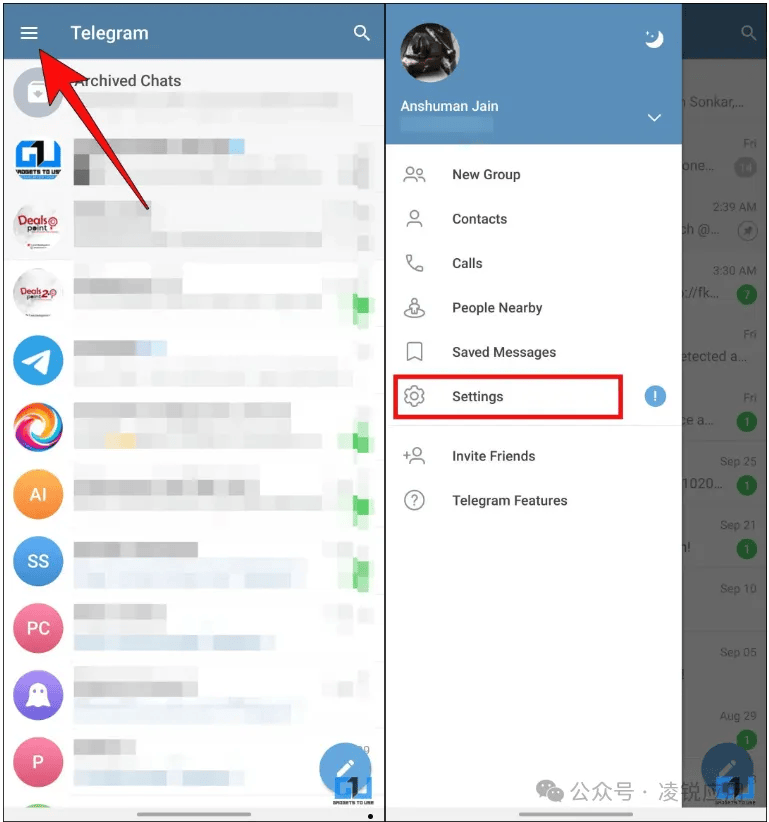

更重要的是,Telegram将大量日常内容的管理权交给了用户和群组管理员。应用内设有可选的“敏感内容过滤器”,用户可以在设置中开启。开启后,系统会自动识别并模糊可能包含成人内容或暴力的媒体,用户需要主动点击才能查看。这种“选择加入”模式,将决定权交给了个体用户,而非由平台统一决定何为“适宜”。

群组与频道的自治生态

Telegram生态的活力很大程度上源于其强大的群组和频道功能。在这里,敏感内容过滤的责任主要落在了创建者和管理员肩上。他们可以设定明确的群组规则、利用机器人进行关键词过滤、删除不当消息,甚至禁言或移除违规成员。这种分布式的内容管理方式,使得不同兴趣、文化和价值观的社区能够形成自己的内容标准。一个学术讨论群可能对内容有严格限制,而一个艺术分享群则可能对裸体作品更为宽容。这种自治性既是Telegram的优势,也要求用户和管理员具备更高的责任感和判断力。

面临的挑战与争议

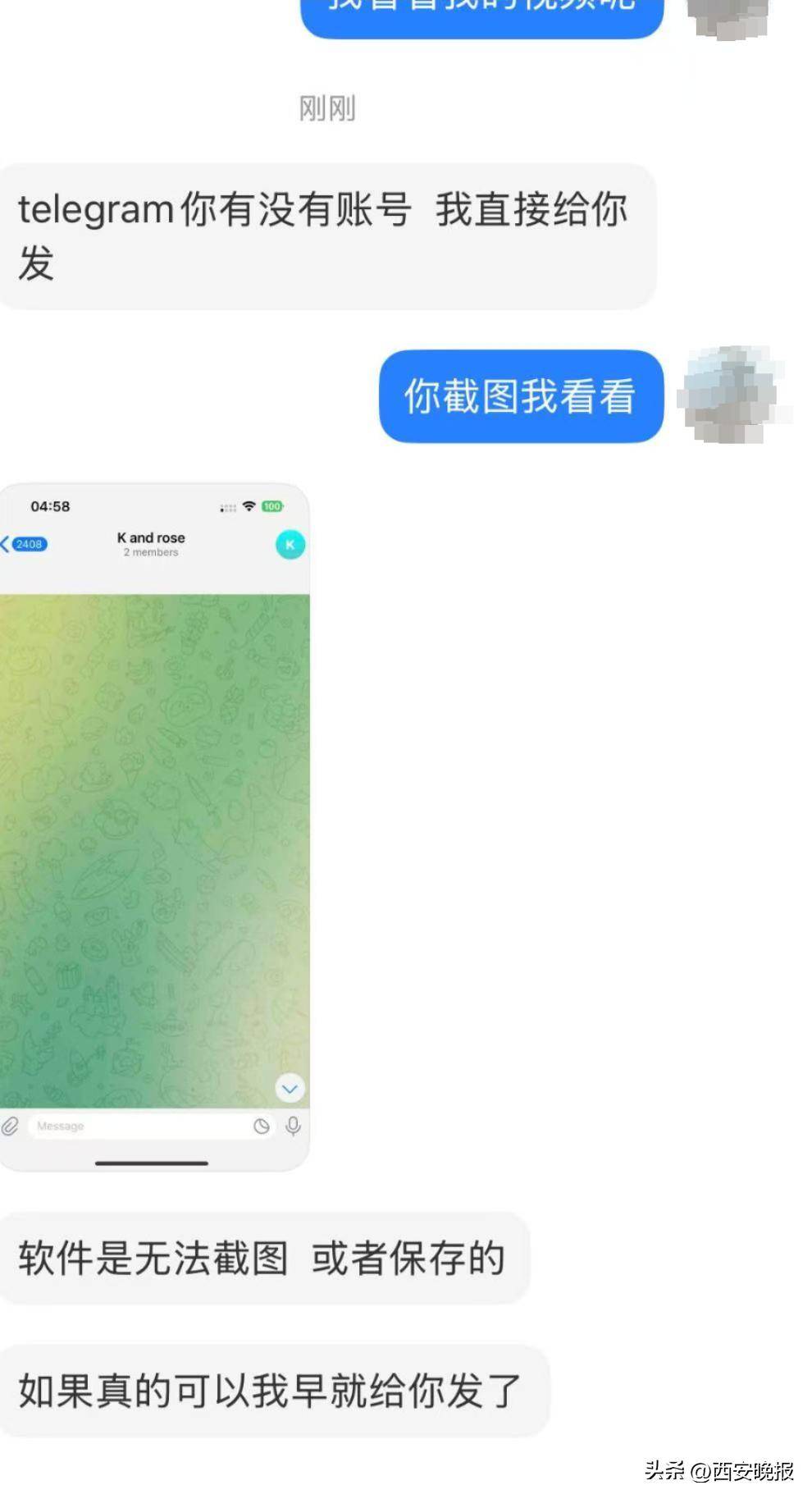

这种以用户自主和社区自治为主的模式,也带来了显著的挑战。批评者指出,这种相对宽松的事前监管,可能使得虚假信息、仇恨言论或极端内容在某些群组中更容易传播。平台需要依赖用户举报来应对这些灰色地带的内容,这可能导致反应滞后或处理标准不一致。此外,不同国家和地区的法律对“敏感内容”的定义差异巨大,Telegram在全球运营时,时常面临遵守当地法规与维护其去中心化理念之间的冲突。如何在尊重本地法律的同时,不损害其全球用户的信任,是一个持续的难题。

未来展望:技术辅助与社区共治

展望未来,Telegram的敏感内容过滤很可能继续沿着“工具赋能”而非“强制干预”的方向发展。我们可能会看到更智能、可定制的过滤机器人,让管理员能更精细地管理内容。平台也可能提供更丰富的隐私与安全设置选项,让用户能个性化自己的信息环境。然而,根本的解决方案或许在于强化“数字素养”和社区共治。教育用户如何识别有害信息、如何有效使用平台提供的管理工具,以及鼓励健康、积极的社区文化,与单纯依赖技术过滤同样重要。

总之,Telegram的敏感内容过滤策略是其整体哲学的一个缩影:它优先考虑用户自由和隐私,将控制权下放,同时设定明确的基本底线。这并非一个完美的解决方案,但它提供了一种不同于传统社交媒体的思考路径——在日益中心化和严格管控的网络世界中,探索如何通过技术工具和社区自治,在自由与责任之间构建一种动态的、由用户参与的平衡。